Nuove pubblicazioni

I cardiologi hanno addestrato un grande modello di intelligenza artificiale per valutare la struttura e la funzione del cuore

Ultima recensione: 14.06.2024

Tutti i contenuti di iLive sono revisionati o verificati da un punto di vista medico per garantire la massima precisione possibile.

Abbiamo linee guida rigorose in materia di sourcing e colleghiamo solo a siti di media affidabili, istituti di ricerca accademici e, ove possibile, studi rivisti dal punto di vista medico. Nota che i numeri tra parentesi ([1], [2], ecc.) Sono link cliccabili per questi studi.

Se ritieni che uno qualsiasi dei nostri contenuti sia impreciso, scaduto o comunque discutibile, selezionalo e premi Ctrl + Invio.

Gli esperti di intelligenza artificiale del Cedars-Sinai e dello Smidt Heart Institute hanno creato un set di dati di oltre 1 milione di ecocardiogrammi (ecografia video del cuore) e le relative interpretazioni cliniche. Utilizzando questo database, hanno sviluppato EchoCLIP, un potente algoritmo di apprendimento automatico in grado di "interpretare" le immagini dell'ecocardiogramma e valutare gli indicatori chiave.

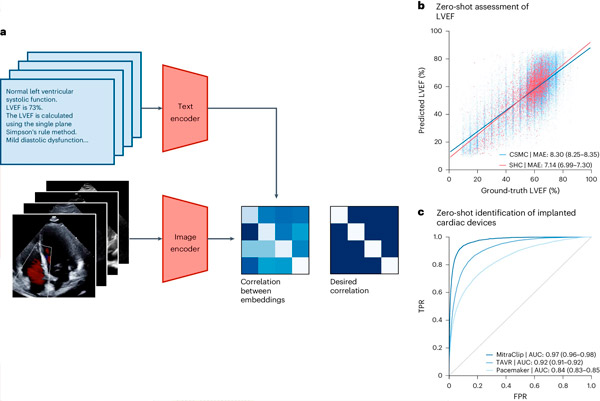

La progettazione e la valutazione di EchoCLIP, descritte in un articolo pubblicato su Nature Medicine, suggerisce che l'interpretazione dell'ecocardiogramma di un paziente utilizzando EchoCLIP fornisce valutazioni cliniche di livello specialistico, tra cui valutazione della funzione cardiaca, risultati di interventi chirurgici precedenti e dispositivi impiantati e può anche aiutare i medici a identificare i pazienti che necessitano di cure.

Il modello EchoCLIP di base può anche identificare lo stesso paziente attraverso più video, esami e punti temporali e riconoscere cambiamenti clinicamente importanti nel cuore del paziente.

"Per quanto ne sappiamo, questo è il modello più grande addestrato su immagini ecocardiografiche", ha affermato l'autore principale dello studio David Ouyang, MD, membro della facoltà della Divisione di Cardiologia presso lo Smidt Heart Institute e il Dipartimento di Intelligenza Artificiale in Medicina.

"Molti precedenti modelli di intelligenza artificiale per ecocardiogrammi vengono addestrati solo su decine di migliaia di esempi. Al contrario, le prestazioni elevate e uniche di EchoCLIP nell'interpretazione delle immagini sono il risultato dell'addestramento su una quantità di dati quasi dieci volte superiore rispetto ai modelli esistenti."

"I nostri risultati mostrano che ampi set di dati di imaging e interpretazione medica sottoposti a revisione paritaria possono fungere da base per l'addestramento di modelli medici di base, che sono una forma di intelligenza artificiale generativa", ha aggiunto Ouyang.

Flusso di lavoro EchoCLIP. Fonte: Medicina naturale (2024). DOI: 10.1038/s41591-024-02959-y

Ha osservato che questo modello di base avanzato potrebbe presto aiutare i cardiologi a valutare gli ecocardiogrammi generando stime preliminari delle misurazioni cardiache, identificando i cambiamenti nel tempo e le malattie comuni.

Il team di ricerca ha creato un set di dati di 1.032.975 video di ecografie cardiache e le relative interpretazioni di esperti per sviluppare EchoCLIP. I principali risultati dello studio includono:

- EchoCLIP ha dimostrato prestazioni elevate nella valutazione della funzione cardiaca da immagini cardiache.

- Il modello di base è stato in grado di identificare dispositivi intracardiaci impiantati come pacemaker, valvole mitraliche e aortiche impiantate dalle immagini dell'ecocardiogramma.

- EchoCLIP ha identificato accuratamente pazienti unici in tutti gli studi, ha identificato cambiamenti clinicamente importanti come precedenti interventi di chirurgia cardiaca e ha consentito lo sviluppo di interpretazioni testuali preliminari delle immagini dell'ecocardiogramma.

"I modelli di base rappresentano una delle aree più recenti dell'intelligenza artificiale generativa, ma la maggior parte dei modelli non dispone di dati medici sufficienti per essere utili in ambito sanitario", ha affermato Christina M. Albert, MD, MPH, presidente della Divisione di Cardiologia presso l'Università Smidt Heart Institute.

Albert, che non è stato coinvolto nello studio, ha aggiunto: "Questo nuovo modello di base integra la visione artificiale per l'interpretazione delle immagini dell'ecocardiogramma con l'elaborazione del linguaggio naturale per migliorare le interpretazioni dei cardiologi."